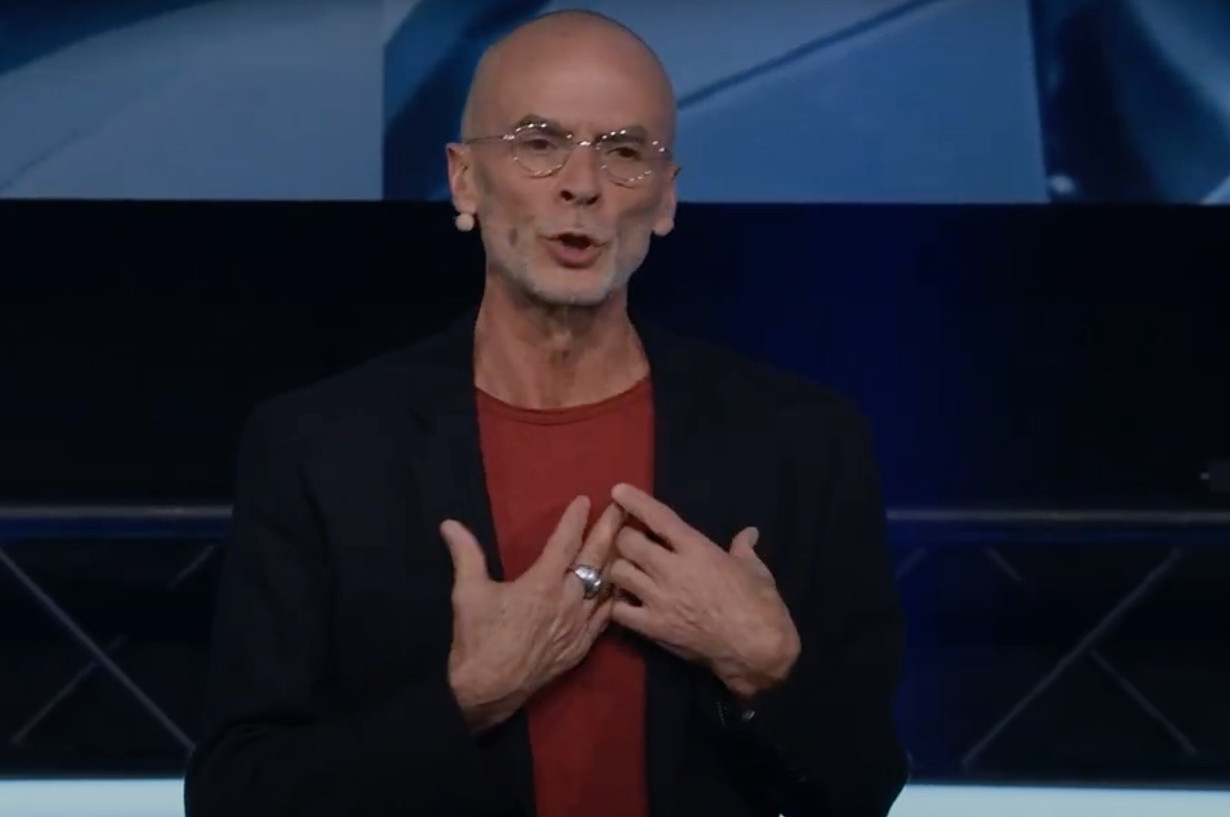

«S’il y a bien une chose que les machines n’auront jamais, c’est le trac. Même si j’ai une longue carrière d’enseignant, se retrouver face à un public n’est jamais quelque chose d’évident…» Samuel Nowakowski, maître de conférences en sciences de l’information et de la communication, chercheur au sein du Laboratoire lorrain de recherche en informatique et ses applications à l’Université de Lorraine, à l’école des Mines de Nancy, ainsi qu’à Sciences Po, a beau avoir l’habitude «d’évangéliser» sur ses thématiques de prédilection, il n’en reste pas moins un homme, et c’est cela qu’il rappelle à l’audience du Luxembourg Sustainability Forum 2024, mardi 22 octobre, au Tramsschapp.

«J’enseigne les humanités numériques! C’est quoi cet oxymore? C’est simplement amener tout individu à s’interroger sur le monde dans lequel nous vivons et en particulier le monde dans lequel la dimension numérique a pris tellement de place que nous ne sommes plus les mêmes humains qu’il y a 30 ans. Un tas d’outils viennent en chasser d’autres de plus en plus rapidement», explique-t-il à une salle partagée entre experts et lycéens. «Nous parlons d’intelligence artificielle avec ces jeunes étudiants qui, un jour, seront des décideurs et je leur fais un cours sur la manière dont ça fonctionne, quels sont les différents éléments.»

Et sur le ton de la confidence: «Un de ces jeunes me dit: ‘J’ai une expérience de l’IA’. Il est scout et, dans son camp scout, on lui a demandé un jour de faire une messe. Comme il ne savait pas comment faire une messe, il a demandé à ChatGPT de lui fabriquer sa messe. Quand il a commencé à regarder ce qu’il y avait dedans, le système avait inventé ou réécrit des passages de la Bible. ChatGPT, par manque d’informations, est allé chercher des éléments dans des textes les plus proches, les plus pertinents d’un point de vue de la probabilité… Le contenu était complètement farfelu! Derrière cette petite anecdote, il y a énormément de choses. Le système peut répondre à toutes les questions, mais seule la critique humaine peut détecter ce qui ne va pas. C’est vrai pour mon étudiant, mais aussi pour des avocats ou des programmeurs… Nous sommes face à des systèmes qui nous remettent en situation de questionner la production du savoir, des connaissances… Ensuite, cela questionne aussi la confiance que nous avions dans une machine automatisée à laquelle nous confiions une tâche, comme dans la production de voitures.»

«Aujourd’hui, vous avez quelque chose qui va produire une information, un contenu, un texte, et cetera, avec un degré de probabilité de confiance, mais vous n’allez pas forcément savoir si c’est fiable à 90%, à 80% ou seulement à 50%. C’est une belle béquille, qui a l’allure d’une béquille, mais dont on va devoir en permanence vérifier qu’elle va nous maintenir ou au moins accomplir la tâche pour laquelle elle a été pensée.»

Comprendre l’IA, enjeu clé

«Je ne suis pas en train de dire que tout est à mettre à la poubelle», précise celui qui, comme le recteur de l’Université du Luxembourg, , est aligné sur l’idée de l’interdisciplinarité. «La question, c’est plutôt de savoir ce que l’on fait de tout ça. Il faut remettre de l’humain et l’humain est hyper important, car il va permettre de discerner ce qui est valable ou non. C’est la capacité à être critique.»

Ses dix minutes de conférence passent trop vite. Et se terminent sur un message plus politique. «Pour moi, c’est un acte de citoyenneté! Et une question de métier – je possède les compétences, ce n’est pas la machine qui va déposséder l’humain et celui qui a le dernier mot. En médecine, sur les scènes de guerre – qui sont terribles, d’accord – l’humain a le dernier mot. Dans une démocratie, cela suppose que les citoyens sont capables de comprendre. Si je veux pouvoir débattre de l’IA, de sa place et de la société que nous construisons avec, il faut que je puisse comprendre ce que j’ai entre les mains et garder les compétences qui sont les nôtres dans l’ensemble du spectre de l’activité inventive de l’humain. Une machine ne sera jamais en capacité d’inventer. La démocratie, ce n’est pas simplement glisser un bulletin de vote dans une urne, c’est aussi et surtout être capable de questionner et d’interroger avec bon sens les grands enjeux de la société», assure celui qui a travaillé avec Steve Jobs, pour Canal+ ou pour le gouvernement français.